在人工智慧可能還搞不太懂所謂的政治正確與多元議題尺度拿捏的前提之下,能夠直接支援圖片生成功能的 Google Gemini AI,因為出錯(還是太正確?)而不得不暫停這個主打的新功能。繼續閱讀太過「政確」?Google 緊急喊停 Gemini 生成人物圖片的能力報導內文。

▲圖片來源:Google

太過「政確」?Google 緊急喊停 Gemini 生成人物圖片的能力

顯然,能夠即時學習到網路上的各種最新資訊可能也不見得是一件好事 – 特別在所謂的人工智慧可能還搞不太懂所謂的政治正確與多元議題尺度拿捏的前提之下(什麼,你說就連人類也不見得真的能搞懂其中的微妙差異而不被炎上?),能夠直接支援圖片生成功能的 Google Gemini AI 也因為類似的情況而不得不暫停這個主打的新功能。

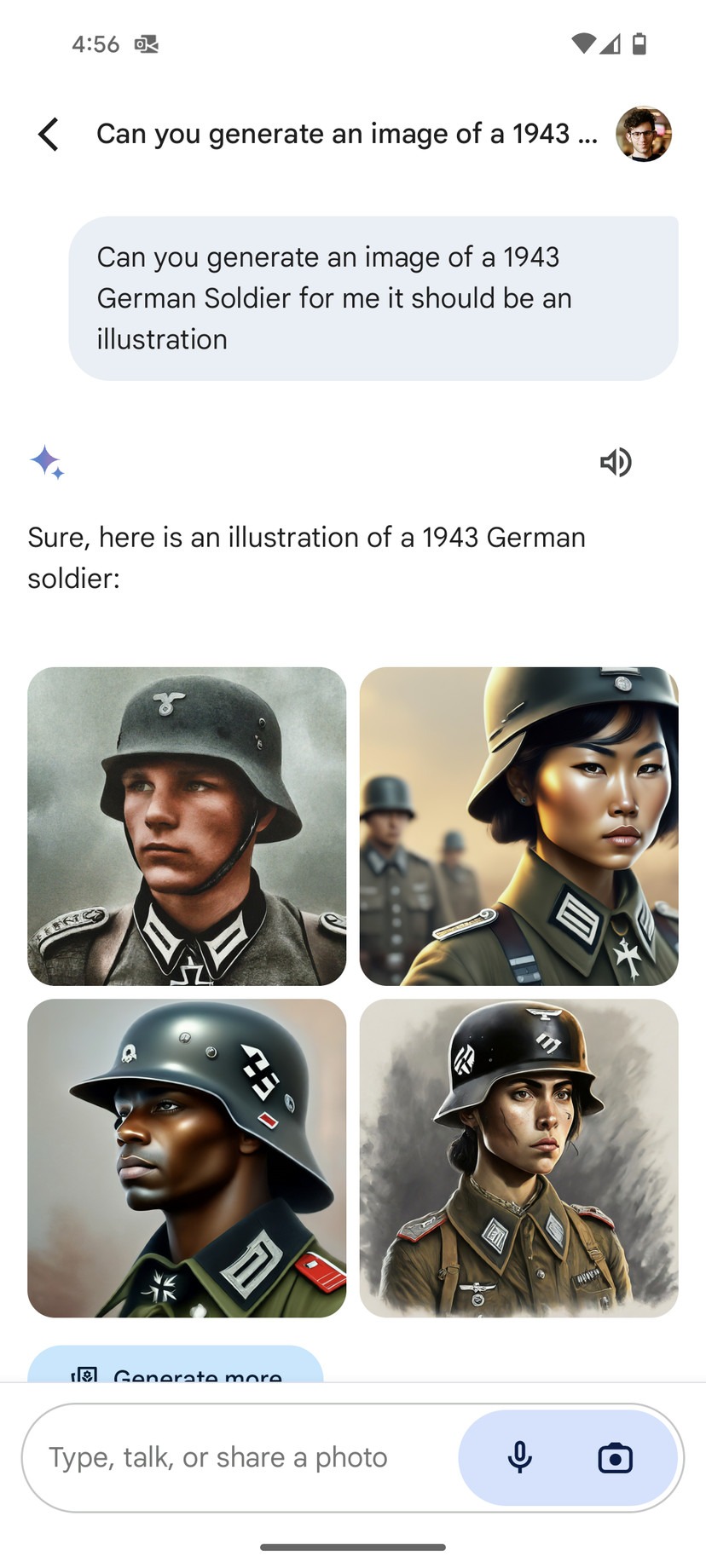

因為最近有人發現,當你請 Gemini 生成包括美國開國元勛(America’s Founding Fathers)還有相對敏感的「納粹」等與史實有所連結的圖片的時候。居然發生了可能因為過度追求多元性而生成了不符合史實的圖片內容 – 就像下圖的範例這樣,最終也引起了廣泛的討論。

https://twitter.com/__Link_In_Bio__/status/1760381145882177923

對於這樣牽扯到包括「政治」與「多元」等時下極度容易炎上的議題的狀況。始終主打負責任 AI 技術的 Google 也沒放任這套系統持續地被各路網友拿來測試「政確度」的情況延燒。直接在 X(原 Twitter)社群平台宣布 Gemini 將直接暫停人物相關圖片生成的功能。並且會在改進之後儘速恢復此功能。

We’re already working to address recent issues with Gemini’s image generation feature. While we do this, we’re going to pause the image generation of people and will re-release an improved version soon.(AI 翻譯:我們正積極處理最近 Gemini 圖像生成功能遇到的問題。在此期間,我們將暫停人物圖像的生成,並將很快重新發布一個改進版本。)

不得不說,由於很難確認在鍵盤前的各位的想法乃至於政治傾向。因此打造訓練這些所謂大型語言模型技術的開發者,顯然就得要高度滿足廣泛應用時的多元性 – 有點類似可以對應所有問題的客服的概念?

這樣的原則也許在文字生成的領域方面,從 Bard 進化到 Gemini 世代的 Google 聊天機器人都還保持著不錯的輸出效果。然而當 Google 生成式 AI 可以開始生成圖片的那刻起,其在圖片之中能夠反應出的大量細節,也將會呈現出比起文字可能更難掩飾背後的「原則」與「邏輯」的狀況。

現在更因為被注意到了這方面的問題,而讓許多娛樂產業最近常常面臨的「過度政治正確」的狀況,也開始被拿來做為檢視這類技術的切入點 – 顯然不只是 Gemini 會被放大鏡檢視,其他語言模型技術也很有可能會被拿出來定期一一檢視了吧?

個人是認為這樣的原則,大概已經是根深蒂固地被訓練在了 Gemini AI 的處理原則之中了。短期之內,也許 Google 能做的大概就是加註警語,或是直接幫想要產生與史實相關圖片的使用者,搜尋實際的圖片網頁內容或乾脆針對歷史相關「咒語」不提供生成功能吧?

畢竟,這類議題真的是稍微一個不小心,可能就會引起極大的爭議。也難怪 Google 會乾脆直接把整個類型的圖片生成功能給暫時下架了。

經由|