AI 技術日益成熟,豐富多元的運用也讓 AI 可以說是無所不在,國外一名開發者推出一款可快速創建女性裸體照片的應用 DeepNude ,正是利用神經網路與演算法來創建相當擬真的女性裸體照片,引起褒貶兩極的反應,在 AI 活用同時似乎也助長了各種惡意假照片的產生。

國外開發者推出 DeepNude 利用 AI 創建女性裸體照片,引發侵犯隱私爭議

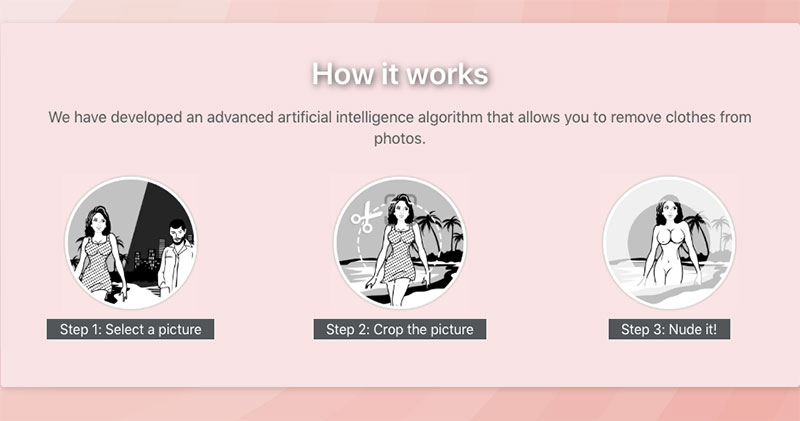

在過去就已經有利用 AI 換臉的應用程式,讓大家玩得很開心,不過接下來要講的應用可能會有全球一半的人口不樂意。一名化名為「Alberto」的開發者最近上架了一款應用程式 DeepNude,只需要在該服務上提供一張照片,就能飛快地利用 AI 創建出非常逼真的裸體照片,使用者所提供的原始照片裸露的皮膚越多,照片越準確真實。該應用不僅有免費版(有浮水印)、50 美元付費版(無浮水印,但有 Fake 標記) ,還提供了網頁版。

國外媒體 Motherboard 對開發者的訪談中,開發者表示,該應用只能用於女性,會開發這款應用的原因在於「有意思、好奇、有趣」。該媒體也進行測試,如果放入男性照片則下體也會被替換成女性器官,且像是穿著比基尼等布料較少的衣服也越擬真。不過這個應用還是有缺點,經過該服務產出的裸體照片(特別是低解析度的)還是會有 AI 拼貼合成的痕跡,當你輸入卡通人物的照片時,所得到的影像將完全扭曲。

在過去就已經有其他利用 Deepfake AI 演算法的成果在網路流通,但這種技術很容易就會成為傷害女性的幫凶,在未經同意的前提下使用女性照片或是在網上惡意散佈色情內容都會對女性造成傷害。反色情報復組織「Badass」的創始人 Katelyn Bowden 表示:「現在每個人都有可能成為色情報復的受害者,即使沒有拍過一張裸體照片,也可能會成為受害者。這樣的技術根本不應該向公眾開放。」而馬里蘭大學凱里法學院(University of Maryland Carey School of Law)Danielle Citron 認為,DeepNude 無疑是在侵犯用戶的性隱私。

雖然得到的照片並非真實,但在網路散布時其他閱聽者根本無從查證,直接對受害者造成多次傷害。開發人員在發想與創作一款應用時,更該將道德前提放在前面,而非僅是因為好奇、有趣等動機,如果僅是實驗性也就罷了,但真正公開釋放出來獲利就必須好好拿捏人性之間的界線才是。

◎資料來源:Motherboard